はじめに

近年、生成AIサービスは急速に進化を遂げ、私たちの日常生活やビジネスシーンにおいて重要な役割を果たすようになっています。特に、ChatGPTをはじめとするテキスト生成型AIは、効率的かつクリエイティブなアウトプットを可能にし、多くの業界で注目を集めています。

その中心に位置するのが、大規模言語モデル(LLM)です。LLM(大規模言語モデル)とは、膨大なデータをもとに学習され、人間のような自然な文章生成や高度な文脈理解を実現します。この技術は、コンテンツ制作やカスタマーサポート、データ分析、翻訳など、多岐にわたる用途で活用されており、AIサービスの中核技術として欠かせない存在です。

本記事では、LLMに関する基本的な知識をわかりやすく解説するとともに、LLMの種類や活用例、さらには代表的な製品についてご紹介します。生成系AIの可能性を最大限に引き出すための第一歩として、ぜひ参考にしてください。

LLM(大規模言語モデル)とは

LLM(大規模言語モデル)とは、テキスト認識や生成をはじめとするさまざまなタスクを実行できる人工知能(AI)プログラムです。「大規模」という名前が示す通り、LLMは膨大なデータセットをもとにトレーニングされています。この技術は、特にトランスフォーマーモデルと呼ばれるニューラルネットワークを活用した機械学習によって構築されています。

簡単に言うと、LLMは大量のサンプルを学習することで、人間の言語やその他の複雑なデータを認識・解釈できるコンピュータープログラムです。

大規模言語モデルと従来の言語モデルでは、「データ量」「計算量」「パラメータ量」が大きく異なります。

- データ量:入力される情報量

- 計算量:コンピューターが処理する計算量

- パラメータ量:確率計算を行うための係数量

さらに、LLMは「ディープラーニング」と呼ばれる機械学習の一種を使用して、文字、単語、文章がどのように構成されているかを理解します。ディープラーニングは、非構造化データの確率的分析を行い、人間の介入なしで内容の違いを認識できるようにモデルを進化させます。

LLM(大規模言語モデル)の歴史

初期の言語処理は、厳密なルールに基づく「ルールベース」のアプローチから始まりました。その後、膨大なデータを活用した「統計的手法」へと移行し、自然言語処理の分野における大きな進化が実現されました。言語モデルでは、人間が使う言い回しや意味を理解した上で、次にどの単語が続くのかを推測します。LLMの開発歴史は以下の表に示します。

| 発表年 | 企業名 | LLM(大規模言語モデル) |

| 2018 | Bert | |

| 2020 | OpenAI | GPT-3 |

| 2021 | LaMDA | |

| 2022 | PaLM | |

| 2022 | Meta | LLaMA |

| 2023 | OpenAI | GPT-4 |

| 2024 | OpenAI | GPT-4o |

2024年5月には、新しい大規模言語モデル「ChatGPT-4o」がリリースされました。

ほとんどの言語モデルは、ディープラーニング技術の一種であるTransformer(トランスフォーマー)を基盤としています。なお、ChatGPTの「T」はこのTransformerを指しています。この技術は、2017年に発表された画期的な論文『Attention Is All You Need』で提唱されました。Transformerの特長は、従来の手法に比べて処理の簡略化を実現し、高速かつ高精度な結果を提供できる点にあります。現在のLLMの急速な進化は、このTransformer技術(ディープラーニングのモデル)によって支えられていると言えるでしょう。

LLM(大規模言語モデル)の種類一覧

現在、さまざまなLLM(大規模言語モデル)が開発されており、それぞれ異なる特長や目的に応じて活用されています。以下の表では、主要なLLMについて、その概要や開発企業、パラメータ数、発表年を比較しています。

| 言語モデル名 | 概要 | 企業名 | パラメータ数 | 発表年 |

| BERT | データセットの規模を増やし精度を向上させた初期の言語モデル | 3.4億 | 2018年 | |

| GPT-4 | GPT-3に、画像や音声などテキスト以外のデータを学習させたモデル | OpenAI | 非公開 | 2023年 |

| LaMDA(Language Model for Dialogue Applications) | Transformerをベースとし、対話に特化させたモデル 1兆5,600億語のテキストコーパスで事前学習を実施 | 未公開 | 2021年 | |

| PaLM(Pathways Language Model) | 論文「Scaling Language Modeling with Pathways」を元にしたモデル Transformerのパラメータ数を大幅に拡大し、高性能を実現 | 5400億 | 2022年 | |

| LLaMA(Large language Model Meta AI) | GPT-3と同等の性能を、圧倒的に少ないパラメータ数で実現 GitHub上でオープンソースとして公開 | Meta | 70~650億 | 2023年 |

| NEMO LLM | 独自の学習データで多様なサイズにカスタマイズ可能 | NVIDIA | 未公開 | 2022年 |

| Claude | GPT-2とGPT-3の開発に携わったエンジニアによるモデル | Anthropic | 未公開 | 2023年 |

| Alpaca 7B | LLaMAをベースとし、Instruction-following(指示実行)の結果を使って ファインチューニングしたモデル | スタンフォード大学 | 70億 | 2023年 |

| Vicuna 13B | LLaMAをベースに、ChatGPTとユーザの会話を学習させた オープンソースのチャットボット | カリフォルニア大学 | 未公開 | 2023年 |

| OpenFlamingo | DeepMindが開発したマルチモーダルモデル 「Flamingo」をオープンソース化 | LAION | 未公開 | 2023年 |

LLM(大規模言語モデル)の仕組み

大規模言語モデルは、以下のようなプロセスで構築されています:

- トークン化:入力された文章を最小単位であるトークンに分割

- ベクトル化: トークン化されたデータを数値のベクトルに変換し、コンピュータが情報を解析可能にする処理

- ニューラルネットワークを通した学習:クはLLMの核となる構造であり、入力データを層ごとに変換・調整しながら特徴を抽出し、単語の出現確率や文脈、関係性を考慮した学習を通じて高度な言語処理能力を実現

- 文脈(コンテキスト)理解

- デコード(出力ベクトルに修正しテキストへ変換)

大規模言語モデルは、主にTransformerアーキテクチャを基盤としています。このアーキテクチャにより、高い精度と効率を兼ね備えた自然言語処理が可能になっています。

従来の言語モデルでは、テキストデータを単語ごとに分割し、人がラベル付けを行う必要がありました。しかし、大規模言語モデルは、膨大な量のテキストデータを基に自動でトークンを解析し、文脈や言葉の意味を学習します。その結果、続く可能性が高い言葉や文章を自然に予測し、生成することができます。

大規模言語モデルは、トークン間の関係性や文脈の深い理解を通じて、スムーズで自然な文章を生成する能力を持っています。この仕組みにより、文章作成や自動翻訳、会話生成など、多岐にわたる用途でその力を発揮しています。

LLM(大規模言語モデル)の活用事例

LLMは現在、生成AI技術の中心的な存在として、コンテンツ制作、翻訳、カスタマーサポートなど、幅広い分野で活用されています。この技術の理解を深めることで、企業や個人が生成AIをより効果的に活用でき、さまざまな業界で利用され、業務効率化やユーザー体験の向上を実現しています。以下に代表的な活用事例を基に具体的な利用例を解説します。

1. Eコマース

フリマアプリ「メルカリ」では、最新の生成AI(Generative AI)と大規模言語モデル(LLM: Large Language Model)を活用した新機能「メルカリAIアシスト」を導入しています。この革新的な機能により、ユーザーの体験をさらに向上させ、出品や購入といったプロセスをよりスムーズかつ効率的に行うことができるようになりました。

「メルカリAIアシスト」では、以下のような便利な機能を提供しています:

- 出品サポート機能:商品の情報を簡単に入力するだけで、自動的に魅力的な商品説明文を生成し、初心者でも簡単に出品が可能になります。

- 価格提案機能:市場のデータを基に、適切な販売価格をAIが提案することで、より早く売れる価格設定をサポートします。

- 問い合わせ応答機能:購入希望者からの質問に対し、自動応答テンプレートを提案することで、出品者の負担を軽減します。

- カテゴリー分類の最適化:AIが商品の情報を分析し、適切なカテゴリーやタグを提案することで、商品がより多くの目に留まりやすくなります。

これらの機能は、AI技術を最大限に活用することで、ユーザーがこれまで感じていた手間や負担を大幅に軽減し、誰もが気軽にフリマアプリを楽しむことができる環境を提供しています。メルカリは、今後もAI技術を活用し、ユーザー体験のさらなる向上を目指しています。

2. 小売り

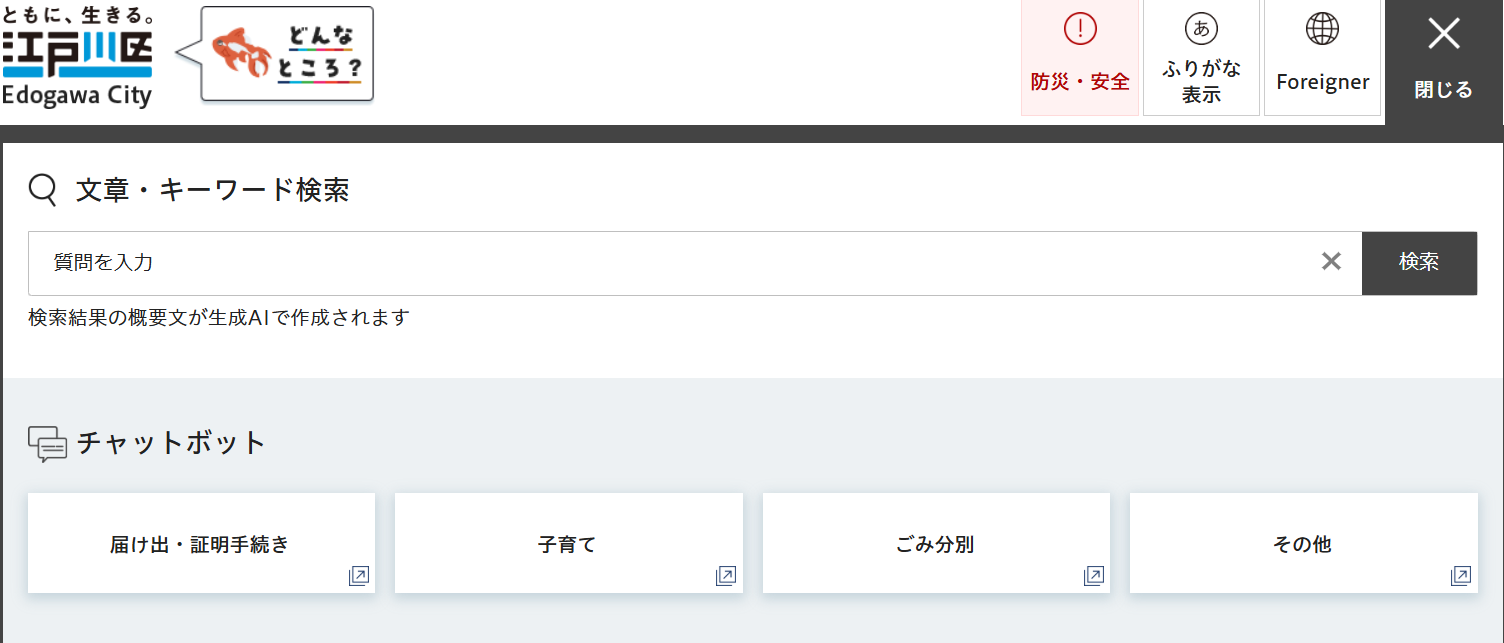

包装資材商社である江戸川物産は、業務効率化と生産性向上を目的に、生成AI技術を活用したChatGPTを導入しています。この取り組みにより、社内のさまざまな業務で効果を上げており、特に以下の分野で顕著な成果が見られています:

- 文書作成の効率化: ChatGPTを活用することで、メルマガやSNS投稿用の文章を短時間で作成できるようになりました。これにより、マーケティング活動のスピードと質が向上し、従来よりも多くの情報発信が可能になっています。

- 新商品のアイデア出し: 商品企画チームでは、ChatGPTを活用して新商品のアイデアをブレインストーミングしています。AIが提案するヒントや新しい視点を取り入れることで、これまでにない革新的な商品の企画が進行しています。

- 製造関連の質問対応: 製造業務においても、ChatGPTは有用なサポートを提供しています。特に、素材の耐熱温度や強度など、製造に関する詳細な質問に対して迅速かつ的確に応答することで、業務の効率化に貢献しています。社員が専門的な情報を素早く入手できるため、意思決定のスピードが向上しました。

江戸川物産では、ChatGPTを活用することで業務負荷を軽減するとともに、社内の生産性とクリエイティビティの向上を実現しています。今後もAIを積極的に活用し、より高度な業務効率化とサービス向上を目指していく予定です。

3. 金融

三菱UFJフィナンシャル・グループ(MUFG)は、業務効率化と生産性向上を目的に、生成AI技術であるChatGPTを今年の夏から社内業務に活用しています。この導入により、特に以下の分野で効果を上げています:

- 書類作成の効率化: 定型業務における書類作成をChatGPTで自動化することで、担当者の手間を大幅に削減しました。これにより、社員はより高度な業務や戦略的なタスクに集中できる環境が整いました。

- 社内の照会対応の迅速化: 社員間での照会対応にChatGPTを活用することで、回答スピードが向上し、業務がスムーズに進むようになりました。これにより、部門間の連携やコミュニケーションの効率も改善されています。

- 日本マイクロソフトとの連携による独自AIの開発: MUFGは、AI活用のさらなる発展を目指し、日本マイクロソフトと提携して独自のAI開発も計画しています。この取り組みは、金融業界特有のニーズに応える新しいAIソリューションの実現を目指すもので、今後のサービス向上に大きな期待が寄せられています。

生成AIの導入により、日々の業務効率を改善しながら、次世代のデジタル金融サービスの基盤を構築しています。今後もAI技術を積極的に活用し、業界をリードする存在としての地位を強化していく予定です。

4. 広告業界

最新の生成AI技術を活用することで、SNS投稿、メルマガ、ブログ記事など、さまざまなマーケティング素材の作成を効率化しています。具体的には、以下のようなメリットを提供しています:

- テキストの自動生成: SNS投稿やメルマガの内容を短時間で作成可能にすることで、日々の情報発信をスムーズに行えるようになりました。これにより、時間の節約だけでなく、内容の質も向上しています。

- ブログ記事の作成支援: 生成AIを活用してブログ記事の骨子を作成し、簡単に説得力のある記事を完成させることができます。記事のテーマやターゲット層に応じて、カスタマイズされた提案が可能です。

- A/Bテスト用コピーの迅速な作成: マーケティングキャンペーンにおいて、異なるバージョンのコピーを生成AIで短時間で作成し、A/Bテストを効率的に実施できます。これにより、パフォーマンスの高いコピーを見つけ出すプロセスが加速します。

生成AIを導入することで、従来よりも迅速かつ柔軟にマーケティング素材を作成できる環境を提供し、効果的なコミュニケーション戦略を実現しています。

5. 製造業

富士通は、製品の組立作業やコンタクトセンターのサポート業務にAI技術を積極的に導入し、大幅な効率化を達成しています。

- 組立作業の自動化: AIが作業手順を学習し、ロボットアームを制御することで、人手に頼っていた製品の組立作業を自動化しています。これにより、作業の効率と正確性が向上し、生産現場の省力化が実現しました。また、画像認識技術の高度化により、製品の欠陥を自動で検出するシステムを開発し、品質管理の精度を向上させています。

- Salesforceの生成AI機能「Einstein for Service」の活用:富士通は、Salesforceの生成AI機能である「Einstein for Service」を導入し、コンタクトセンターのサポート業務に活用しています。この技術で、応答時間の短縮(オペレーターの平均処理時間を約20分から約2分に短縮し、89%の削減効果を実現)と会話サマリーの自動生成(会話後の処理時間を約86%削減し、オペレーターの負担を大幅に軽減)ができました。

生成AIを活用したこれらの取り組みにより、サポートデスクの効率化と顧客満足度の向上が実現しました。また、組立作業の自動化と欠陥検出システムの導入により、生産性と品質の両面で成果を上げています。

まとめ

本記事では、LLM(大規模言語モデル)の基本からその仕組み、歴史、種類、そして活用事例までを詳しく解説しました。LLMは自然言語処理を中心に、データの解析やパターンの抽出、人間の意思決定を補助するツールとしての役割を果たしており、その可能性は無限大です。

例えば、LLMはカスタマーサービスにおけるチャットボットとして活躍するだけでなく、Eコマース、小売り、金融など多岐にわたる業界で応用されています。さらに、業務効率化やコスト削減を目指す企業にとって、LLMを活用したAIソリューションは不可欠な存在となりつつあります。

大規模言語モデルの可能性を最大限に活用するために、AIソリューションの導入が注目されています。HBLABでは、大規模言語モデルを活用した多彩なAIソリューションを提供しており、プロセス自動化、業務効率化、そして企業の個別ニーズに応じたAIツールを設計・開発しています。弊社のプロジェクトの進行速度はかなり速く、中規模のプロジェクトで約2〜3ヶ月かかります。顧客満足度は95%に達します。生成AIの分野の専門家がおり、5年間の経験があります。コンサルティングと実装を両立することができます。

HBLABのAIソリューションについて詳しく知りたい方はこちらをご覧ください:

とは-1024x538.png)